Influencer AI Teratas 2025: Terverifikasi, Dihormati, Diikuti

Singkatnya Mari kita lihat sepuluh tokoh yang membentuk masa depan kecerdasan buatan di tahun 2025 — mulai dari laboratorium yang menyempurnakan desain intinya hingga para pembuat kebijakan yang menetapkan batasannya. Gagasan, penelitian, dan kepemimpinan mereka mendorong perubahan nyata dalam cara AI dibangun, dibagikan, dan digunakan di seluruh dunia.

Kecerdasan buatan pada tahun 2025 telah melampaui sekadar sensasi. Kini, kecerdasan buatan didorong oleh riset yang terbukti, infrastruktur yang lebih kuat, dan realitas dalam membangun produk yang tahan lama. X (sebelumnya Twitter) Banyak orang yang memimpin diskusi ini juga memimpin teknologi. Mereka merancang, mempelajari, dan mengelola sistem yang membentuk penggunaannya dalam bisnis, penelitian, dan proyek sumber terbuka.

Ini bukan daftar selebritas. Setiap orang di sini memiliki dampak nyata, keahlian yang jelas, dan rekam jejak dalam mengarahkan diskusi dalam komunitas AI. Pandangan mereka penting karena berasal dari proses membangun, memandu, dan menantang sistem yang membentuk masa depan kita.

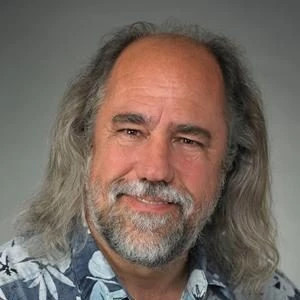

Yann LeCun (@ylecun) — Kepala Ilmuwan AI di meta

Yann LeCun tetap menjadi salah satu suara terkuat di bidang AI, terutama dalam riset fundamental. Komentar publiknya seringkali bertentangan dengan momentum yang ada, terutama dalam perdebatan mengenai model bahasa berskala besar. Ia berargumen bahwa sistem yang belajar dengan data yang jauh lebih sedikit dan mengonsumsi energi yang jauh lebih sedikit, berbeda dari pola pikir "semakin besar selalu lebih baik".

Jejak LeCun dalam sejarah diperkuat dengan penemuan jaringan saraf konvolusional (CNN), yang kini penting bagi visi komputer. Kini, ia adalah pendukung utama pembelajaran mandiri dan AI otonom — mesin yang mengembangkan pemahaman melalui observasi, alih-alih penyerapan data tanpa henti.

Sekarang, ia jarang membuat twit berisi konten orisinal, tetapi sering kali memposting ulang atau menautkan ke esai mendalam tentang penelitian AI dan desain sistem.

- Tema inti: arsitektur hemat energi, pembelajaran yang berpusat pada objek, model dunia;

- Jangkauan audiens: 900,000+ pengikut;

- Dinamika yang menonjol: pertukaran teknis yang sering terjadi dengan para peneliti di OpenAI dan DeepMind;

Selama lebih dari tiga puluh tahun, karyanya telah membentuk strategi AI Meta, yang bertujuan menciptakan sistem yang mengamati dan berpikir dengan cara yang lebih dekat dengan penalaran manusia, bukan sekadar memprediksi kata berikutnya dalam suatu urutan.

Andrej Karpathy (@karpathy) — Anggota pendiri OpenAI

Andrej Karpathy memadukan keahlian teknis yang mendalam dengan perspektif seseorang yang telah mewujudkan produk-produk hebat. Ia menguraikan ide-ide kompleks — mulai dari desain model hingga pilihan pelatihan dan hambatan penerapan — dengan cara yang selaras dengan para peneliti maupun pengembang langsung.

Umpannya menggabungkan wawasan teknis dengan visi—misalnya, ia baru-baru ini mengusulkan bahwa model bahasa yang besar menjadi blok pembangun perangkat lunak modern.

- Warisan: terobosan awal dalam pembelajaran mendalam dan visi komputer, kepemimpinan AI di Tesla ;

- Jangkauan: lebih dari 1 juta pengikut;

- Keterlibatan: pembicaraan konferensi dan pendidikan masyarakat yang sering dilakukan;

Setelah kembali ke OpenAI Pada tahun 2024, Karpathy berfokus pada upaya membuat model lebih mudah dikelola dan meningkatkan skalanya tanpa kehilangan kendali. Ia juga berupaya membuka lebih banyak sumber daya bagi komunitas pengembang. Dalam postingannya, ia menghubungkan pemikiran teknis yang mendalam dengan pekerjaan sehari-hari dalam membangun perangkat lunak, memberikan para insinyur cara praktis untuk menciptakan sistem yang tahan terhadap penggunaan di dunia nyata.

Fei-Fei Li (@drfeifei) — Profesor di Stanford

Fei-Fei Li telah membangun reputasinya dengan menyelaraskan AI dengan kebutuhan manusia. Ia mendorong desain yang melayani layanan kesehatan, pendidikan, dan kepentingan publik, sama seperti desain tersebut melayani agenda perusahaan atau pemerintah. Ia memimpin penciptaan ImageNet, sebuah proyek yang membentuk kembali pembelajaran mendalam dan meninggalkan salah satu jejak terkuat pada AI saat ini.

Tulisannya berfokus pada sisi manusiawi AI—implikasi etika, dampak terhadap perawatan kesehatan, dan pentingnya menjaga martabat manusia.

- Dikenal sebagai: IMAGEnet Institut AI yang Berpusat pada Manusia di Stanford;

- Pemirsa: 500,000+ pengikut, memberi nasihat kepada para pembuat kebijakan AS dan internasional;

- Fokus saat ini: etika, aksesibilitas, dan inklusi sosial dalam aplikasi AI;

Ia menghadirkan perspektif dari orang-orang yang sering terabaikan di dunia teknologi — seperti tenaga medis, pendidik, dan penyandang disabilitas — dan tetap berfokus pada keprihatinan mereka. Li membingkai AI yang bertanggung jawab sebagai persoalan empati, visi ke depan, dan partisipasi dari suara-suara yang jauh di luar ruang rapat Silicon Valley.

Emad Mostaque (@EMostaque) — Pendiri Stability AI

Emad Mostaque adalah seorang defiSosok penting dalam AI generatif sumber terbuka. Ia mendorong agar model dan kumpulan data dapat diakses di luar jangkauan perusahaan besar, yang memengaruhi gelombang perusahaan rintisan untuk merilis sistem dengan bobot terbuka.

Di umpannya, ia berbagi informasi terkini yang jelas tentang AI generatif sumber terbuka dan undangan bagi publik untuk memberikan masukan tentang pengembangannya.

- Tonggak sejarah: peluncuran Stable Diffusion;

- Area fokus: transparansi biaya, keterbukaan infrastruktur, prinsip-prinsip keselamatan AI;

- Pemirsa: 250,000+ pengikut;

Mostaque secara rutin menguraikan biaya dan kendala nyata dalam membangun model-model canggih, menawarkan pandangan langka tentang anggaran dan upaya teknis yang menggerakkan perangkat generatif. Kegigihannya dalam keterbukaan telah mengubah ekspektasi tentang apa yang seharusnya dapat diperiksa dan dikendalikan oleh pengembang dan peneliti.

Timnit Gebru (@timnitGebru) — Pendiri Institut DAIR

Penelitian Timnit Gebru tentang bias algoritmik dan transparansi data telah mengubah cara pembahasan keadilan AI di skala global. Ia mengkaji siapa yang memegang kekuasaan dalam pengembangan AI dan bagaimana kekuasaan tersebut membentuk hasil.

Dia menggunakan kehadirannya untuk menyoroti masalah bias, sering kali merujuk pada penelitiannya atau perkembangan kebijakan utama tentang keadilan dalam AI.

- Bidang utama: bias sistemik dalam LLM, tata kelola yang dipimpin komunitas, standar data etis;

- Pemirsa: 160,000+ pengikut; dikutip dalam kerangka kebijakan di seluruh dunia;

Ia membangun argumennya berdasarkan bukti yang jelas. Studinya mengungkap bagaimana kelemahan dalam data pelatihan dapat memicu ketidaksetaraan di dunia nyata yang terkait dengan ras, gender, dan kelas. Para pembuat undang-undang dan regulator kini merujuk penelitiannya ketika menyusun aturan, yang menjadikannya suara kritis terdepan dalam diskusi ini.

Chris Olah (@ch402) — Salah satu pendiri Antropik

Chris Olah telah mengungkap beberapa bagian paling rumit dari jaringan saraf. Penjelasan visual dan naratifnya tentang bagaimana model memproses informasi telah menjadi bahan ajar di universitas dan titik referensi bagi para peneliti keamanan AI.

Ia kerap mengunggah pembaruan interpretabilitas—karyanya baru-baru ini mengenai analisis rangkaian model sumber terbuka menarik perhatian di kalangan penelitian keselamatan.

- Spesialisasi: alat interpretabilitas, visualisasi jalur keputusan;

- Pemirsa: 150,000+ pengikut;

- Pekerjaan terkini: penyelarasan model, protokol keselamatan, AI Konstitusional;

Dengan memvisualisasikan cara kerja internal AI, Olah telah mengubah interpretabilitas dari sekadar keingintahuan akademis menjadi persyaratan utama untuk kepercayaan dan keamanan. Pengaruhnya membentuk cara laboratorium dan pembuat kebijakan berpikir tentang pemantauan dan pengarahan perilaku model.

Sara Hooker (@sarahookr) — Direktur di Cohere Untuk AI

Sara Hooker berupaya membuat pembelajaran mesin lebih efisien dan lebih mudah diakses. Ia menyoroti para peneliti di wilayah dengan sumber daya lebih sedikit, dengan tujuan mendesentralisasikan siapa yang dapat berkontribusi di bidang ini.

Tulisannya menyoroti inklusivitas dalam penelitian AI—baru-baru ini ia menarik perhatian pada batasan regulasi berbasis komputasi.

- Fokus utama: model jarang, reproduktifitas, penelitian AI inklusif;

- Pemirsa: 45,000+ pengikut;

Karyanya mempertanyakan keyakinan bahwa riset serius hanya dapat terjadi dengan infrastruktur yang besar. Dengan mempromosikan arsitektur yang efisien dan kolaborasi global, Hooker membentuk kembali ekspektasi terhadap performa dan partisipasi dalam AI.

Ethan Mollick (@emollick) — Profesor di Wharton

Ethan Mollick mendemonstrasikan bagaimana perangkat AI mengubah cara orang belajar dan bekerja. Eksperimennya dengan model bahasa berskala besar di ruang kelas dan lingkungan bisnis menawarkan hasil yang konkret dan dapat direplikasi.

Umpannya menghadirkan AI ke dalam kelas dan skenario kantor yang sesungguhnya—menjelajahi bagaimana desain yang cepat dan peralatan di tempat kerja berkembang dan memengaruhi pembelajaran.

- Bidang fokus: LLM terapan, rekayasa cepat, alur kerja berbantuan AI;

- Pemirsa: 280,000+ pengikut;

Mollick bekerja dengan mencoba sendiri perangkat-perangkat tersebut, mengamati perkembangannya, dan menyesuaikan pendekatannya. Siklus praktis ini memberikan para pendidik dan profesional cetak biru untuk mengintegrasikan AI dengan perkiraan yang minimal.

Dario Amodei (@darioamodei) — CEO dari Antropik

Dario Amodei memimpin salah satu upaya keamanan AI yang paling diawasi ketat. Pengembangan Anthropic Claude merupakan bagian dari strategi yang lebih besar untuk membuat penskalaan lebih aman tanpa menghambat inovasi.

Dia jarang memposting, tetapi saat dia melakukannya, pandangannya mengundang perdebatan—baru-baru ini dia mengkritik narasi yang dia gambarkan sebagai distorsi terhadap misi Anthropic yang mengutamakan keselamatan.

- Fokus: AI konstitusional, keandalan sistem, penyelarasan dalam skala besar;

- Pemirsa: 70,000+ pengikut; diakui dalam sidang legislatif dan pertemuan puncak global;

Gaya Amodei yang terukur dan penekanan pada mekanisme kontrol telah menjadikan karyanya sebagai titik acuan bagi industri dan pemerintah dalam menetapkan ekspektasi untuk pengawasan model.

Grady Booch (@Grady_Booch) — Kepala Ilmuwan untuk Rekayasa Perangkat Lunak di Penelitian IBM

Karier Grady Booch dibangun di seputar perancangan dan pengelolaan sistem perangkat lunak yang kompleks, yang menjadikan pandangannya tentang bagaimana AI modern dibangun dan dipelihara sangat berharga. Puluhan tahun yang dihabiskannya merancang sistem yang dirancang untuk bertahan lama memungkinkannya untuk menyoroti apa yang dibutuhkan rekayasa AI yang berkelanjutan.

Suaranya menggabungkan perspektif desain sistem yang mendalam dengan konteks AI—meskipun pembaruannya kurang sering, ia menghadirkan kejelasan arsitektur pada perdebatan AI.

Terkenal karena menciptakan UML (Unified Modeling Language), Booch menerapkan pemikiran arsitektur yang ketat pada pertanyaan tentang penerapan dan keandalan AI.

- Tema inti: desain sistem, daya tahan, etika dalam rekayasa;

- Pemirsa: 160,000+ pengikut yang mencakup komunitas AI dan teknik tradisional;

Ia memperingatkan bahwa bergerak terlalu cepat berisiko merusak fondasi yang telah dibangun. Baginya, kemajuan yang berkelanjutan datang dari desain yang sabar, pengujian yang ketat, dan komitmen terhadap praktik rekayasa yang kuat.

Disclaimer: Konten pada artikel ini hanya merefleksikan opini penulis dan tidak mewakili platform ini dengan kapasitas apa pun. Artikel ini tidak dimaksudkan sebagai referensi untuk membuat keputusan investasi.

Kamu mungkin juga menyukai

CandyBomb x SAPIEN: Trading futures untuk berbagi 150,000 SAPIEN!

Kejuaraan Klub Trading Bitget (Tahap 5)—Raih bagian dari 80.000 BGB, hingga 800 BGB per pengguna!

Karnaval Bitget x DGC: Dapatkan bagian dari 6.480.000.000 DGC

Bitget akan mendukung fungsi pinjaman dan margin untuk aset terpilih di akun terpadu