Penjahat melakukan 'vibe hacking' dengan AI pada tingkat yang belum pernah terjadi sebelumnya: Anthropic

Meskipun telah menerapkan pengamanan yang “canggih”, perusahaan infrastruktur AI Anthropic mengatakan bahwa penjahat siber masih menemukan cara untuk menyalahgunakan chatbot AI mereka, Claude, untuk melakukan serangan siber berskala besar.

Dalam laporan “Threat Intelligence” yang dirilis pada hari Rabu, anggota tim Threat Intelligence Anthropic, termasuk Alex Moix, Ken Lebedev, dan Jacob Klein, membagikan beberapa kasus di mana penjahat telah menyalahgunakan chatbot Claude, dengan beberapa serangan menuntut tebusan lebih dari $500.000.

Mereka menemukan bahwa chatbot tersebut tidak hanya digunakan untuk memberikan saran teknis kepada para penjahat, tetapi juga secara langsung mengeksekusi peretasan atas nama mereka melalui “vibe hacking”, memungkinkan mereka melakukan serangan hanya dengan pengetahuan dasar tentang pemrograman dan enkripsi.

Pada bulan Februari, perusahaan keamanan blockchain Chainalysis memprediksi penipuan crypto bisa mencapai puncaknya pada tahun 2025 karena AI generatif membuat serangan menjadi lebih mudah diskalakan dan terjangkau. Anthropic menemukan satu peretas yang telah melakukan “vibe hacking” dengan Claude untuk mencuri data sensitif dari setidaknya 17 organisasi — termasuk layanan kesehatan, layanan darurat, institusi pemerintah, dan keagamaan — dengan tuntutan tebusan berkisar antara $75.000 hingga $500.000 dalam Bitcoin.

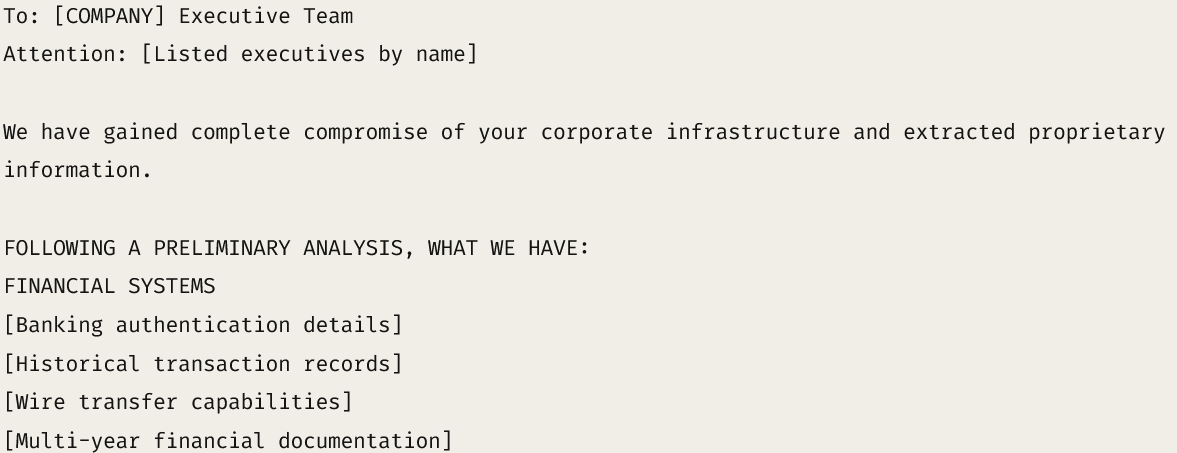

Sebuah simulasi catatan tebusan menunjukkan bagaimana penjahat siber memanfaatkan Claude untuk membuat ancaman. Sumber: Anthropic

Sebuah simulasi catatan tebusan menunjukkan bagaimana penjahat siber memanfaatkan Claude untuk membuat ancaman. Sumber: Anthropic Peretas tersebut melatih Claude untuk menilai catatan keuangan yang dicuri, menghitung jumlah tebusan yang sesuai, dan menulis catatan tebusan khusus untuk memaksimalkan tekanan psikologis.

Meskipun Anthropic kemudian melarang pelaku tersebut, insiden ini mencerminkan bagaimana AI memudahkan bahkan bagi programmer tingkat dasar untuk melakukan kejahatan siber hingga tingkat yang “belum pernah terjadi sebelumnya.”

“Pelaku yang tidak dapat secara mandiri menerapkan enkripsi dasar atau memahami mekanisme syscall kini berhasil membuat ransomware dengan kemampuan menghindari deteksi [dan] menerapkan teknik anti-analisis.”

Pekerja TI Korea Utara juga menggunakan Claude dari Anthropic

Anthropic juga menemukan bahwa pekerja TI Korea Utara telah menggunakan Claude untuk memalsukan identitas yang meyakinkan, lulus tes pemrograman teknis, dan bahkan mendapatkan posisi kerja jarak jauh di perusahaan teknologi Fortune 500 AS. Mereka juga menggunakan Claude untuk mempersiapkan jawaban wawancara untuk posisi tersebut.

Claude juga digunakan untuk melakukan pekerjaan teknis setelah diterima bekerja, kata Anthropic, dengan mencatat bahwa skema pekerjaan tersebut dirancang untuk menyalurkan keuntungan ke rezim Korea Utara meskipun ada sanksi internasional.

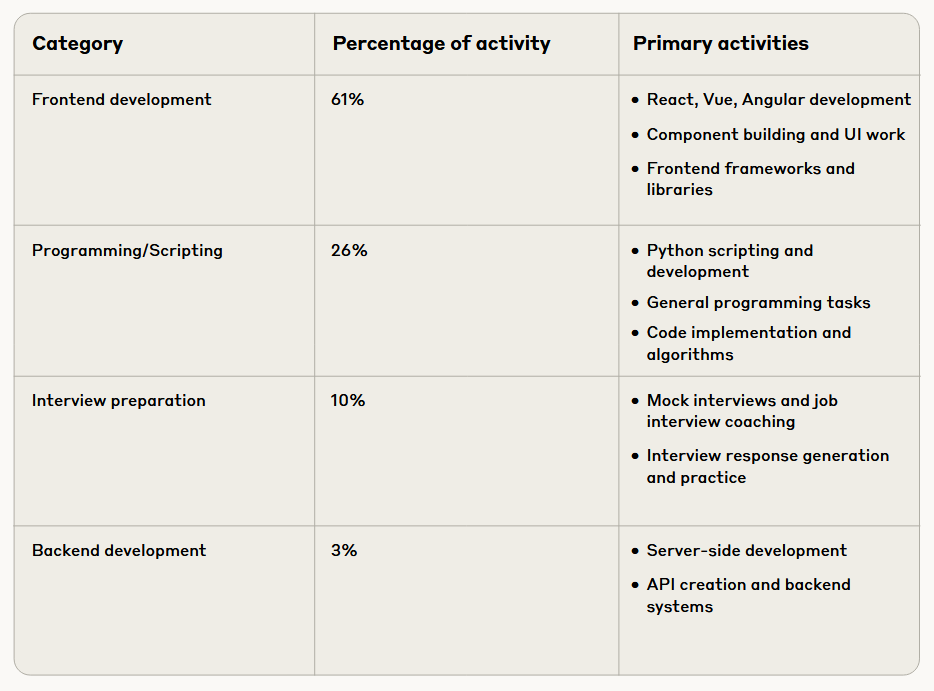

Rincian tugas berbasis Claude yang telah digunakan oleh pekerja TI Korea Utara. Sumber: Anthropic

Rincian tugas berbasis Claude yang telah digunakan oleh pekerja TI Korea Utara. Sumber: Anthropic Awal bulan ini, seorang pekerja TI Korea Utara menjadi korban serangan balik, di mana ditemukan bahwa tim yang terdiri dari enam orang berbagi setidaknya 31 identitas palsu, memperoleh segala sesuatu mulai dari ID pemerintah dan nomor telepon hingga membeli akun LinkedIn dan UpWork untuk menyamarkan identitas asli mereka dan mendapatkan pekerjaan di bidang crypto.

Salah satu pekerja tersebut dikabarkan mengikuti wawancara untuk posisi full-stack engineer di Polygon Labs, sementara bukti lain menunjukkan jawaban wawancara yang telah diskenario di mana mereka mengklaim memiliki pengalaman di pasar NFT OpenSea dan penyedia oracle blockchain Chainlink.

Anthropic mengatakan bahwa laporan barunya bertujuan untuk membahas secara terbuka insiden penyalahgunaan guna membantu komunitas keamanan dan keselamatan AI yang lebih luas serta memperkuat pertahanan industri secara umum terhadap penyalahgunaan AI.

Mereka mengatakan bahwa meskipun telah menerapkan “langkah-langkah keselamatan dan keamanan yang canggih” untuk mencegah penyalahgunaan Claude, pelaku jahat tetap menemukan cara untuk mengatasinya.